Índice:

A pressão por otimização de custos em TI leva equipes de infraestrutura a avaliar equipamentos de entrada para tarefas corporativas.

Essa economia inicial, no entanto, frequentemente se converte em instabilidade operacional e falhas de acesso sob carga real.

A necessidade de governança, desempenho previsível e integração com sistemas legados força uma análise mais profunda dessas escolhas.

Por isso, entender os limites de um storage NAS de perfil doméstico se torna crucial antes de sua adoção em qualquer camada da produção.

O apelo do custo e a realidade

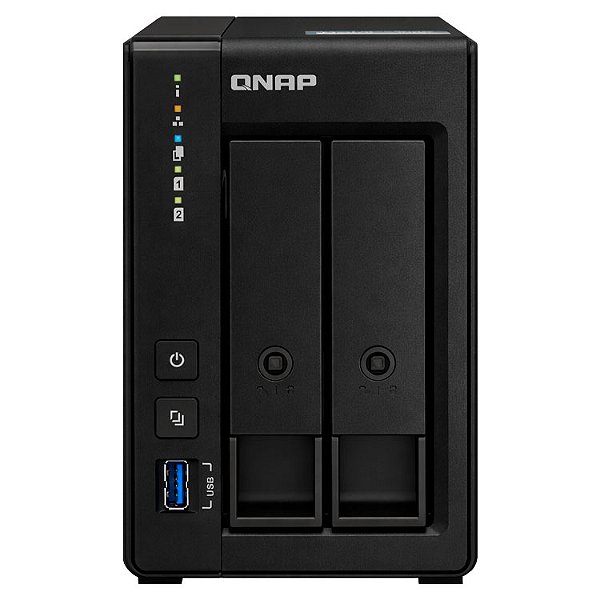

A escolha de um storage NAS como o da Ugreen para ambientes corporativos parte da busca por redução de custos, mas frequentemente ignora as limitações de arquitetura, a ausência de integração com diretórios como Active Directory, a fragilidade em rotinas de backup e a incapacidade de sustentar o desempenho exigido por acessos simultâneos, virtualização ou bancos de dados.

Equipamentos dessa categoria são projetados para o mercado SOHO. Eles usam processadores de baixo consumo e memória RAM limitada, suficientes para tarefas domésticas como backup de notebooks ou streaming de mídia.

Em um ambiente empresarial, essa mesma arquitetura de hardware encontra seu limite muito cedo. A demanda de um servidor de arquivos com dezenas de usuários ou a carga de I/O de uma única máquina virtual já esgota os recursos do sistema.

O software embarcado reflete essa origem. A interface de gestão é simplificada e focada em usuários sem conhecimento técnico, sem as ferramentas de monitoramento, alerta e automação que o time de TI do datacenter precisa para manter a continuidade operacional.

Arquitetura de rede e protocolos limitados

A conectividade de rede é um dos primeiros gargalos a aparecer. A maioria dos sistemas de armazenamento de entrada opera com uma ou duas portas de 1GbE, sem suporte nativo para agregação de link ou interfaces de 10GbE.

Essa limitação de throughput impacta diretamente a janela de backup. A transferência de grandes volumes de dados de servidores ou máquinas virtuais estoura o tempo planejado e interfere com o horário de produção.

A falta de suporte robusto para VLANs também é um problema sério. A equipe de redes não consegue segmentar o tráfego de armazenamento, o que mistura dados de produção, gerenciamento e backup na mesma rede e eleva o risco de segurança e a disputa por banda.

Protocolos de bloco como iSCSI, se disponíveis, operam de forma básica. Eles não trazem as otimizações necessárias para sustentar datastores de hipervisores como VMware ou Hyper-V sob carga, onde a latência de I/O é crítica para o desempenho das máquinas virtuais.

Controle de acesso e governança ausentes

A gestão de permissões em um ambiente corporativo precisa ser centralizada. Um storage NAS que não se integra ao Active Directory ou LDAP força o administrador a criar e gerenciar usuários localmente no próprio equipamento.

Essa ausência de integração gera uma sobrecarga operacional imensa. A equipe de infraestrutura precisa replicar manualmente contas e senhas e não consegue aplicar políticas de grupo (GPO) de forma consistente.

O resultado é um controle de acesso frágil e propenso a erros. Um analista de infraestrutura perde tempo com tarefas repetitivas e a segurança da informação fica comprometida, pois as permissões não refletem a estrutura de cargos e departamentos da empresa.

A trilha de auditoria é outro ponto fraco. Os logs de acesso a arquivos e pastas são superficiais ou inexistentes, o que impede a rastreabilidade em caso de exclusão acidental, vazamento de dados ou incidente de ransomware. Uma auditoria de conformidade não fecha.

Proteção de dados e recuperação frágeis

Muitos gestores confundem a proteção de disco do RAID com uma estratégia de backup. RAID protege contra a falha de um ou mais discos, mas não protege contra erro humano, corrupção de arquivos ou um ataque de ransomware.

A funcionalidade de snapshot em sistemas de entrada é, na maioria das vezes, rudimentar. Ela não possui integração com aplicações como VSS (Volume Shadow Copy Service) da Microsoft, o que impede a criação de cópias consistentes de bancos de dados ou máquinas virtuais.

A recuperação de um volume inteiro ou de um servidor de arquivos se torna um processo manual. Sem automação e validação, o time de TI enfrenta um tempo de restauração longo e imprevisível, com alto risco de perda de dados.

Em um cenário de desastre, a falta de recursos de replicação para uma unidade externa ou para outra filial deixa a operação totalmente exposta. A continuidade do negócio depende de uma arquitetura de proteção que esses sistemas simplesmente não entregam.

Desempenho sob carga simultânea

O desempenho de um storage NAS não se mede apenas pela velocidade de uma única transferência de arquivo. A verdadeira prova de fogo em um ambiente corporativo é a resposta do sistema sob acessos concorrentes.

Durante o horário comercial, dezenas de usuários acessam o servidor de arquivos ao mesmo tempo. Em um sistema de entrada, a disputa de I/O entre leitura e escrita rapidamente degrada a experiência de todos e o acesso aos arquivos trava.

A mesma condição ocorre em ambientes de virtualização. Mesmo com poucas máquinas virtuais, a concorrência por IOPS em um datastore compartilhado sobrecarrega o controlador do NAS. Isso resulta em alta latência para as VMs e serviços lentos ou indisponíveis.

A ausência de cache SSD ou de tiering automático agrava o problema. Todo o processamento de I/O depende diretamente do desempenho dos discos mecânicos, sem uma camada de aceleração para as operações mais frequentes.

Limites de expansão e ciclo de vida

O crescimento do volume de dados é uma constante em qualquer empresa. Um storage NAS de entrada oferece pouca ou nenhuma opção de expansão de capacidade sem uma parada longa para troca de discos.

Esses sistemas não suportam a conexão de unidades de expansão (JBOD). Para aumentar o espaço, o administrador precisa substituir os discos existentes por outros de maior capacidade, um processo que envolve a reconstrução do RAID e deixa o sistema vulnerável por horas ou dias.

O ciclo de vida do produto também é um fator de risco. Equipamentos voltados ao consumidor recebem atualizações de firmware por um período curto e o suporte técnico é limitado ao horário comercial, com troca de peças demorada.

Para a infraestrutura de TI, essa falta de previsibilidade e suporte é inaceitável. Uma falha de hardware pode significar dias de downtime, um impacto financeiro que supera em muito a economia inicial com a compra do equipamento.

Análise técnica para decisão informada

A decisão de usar um storage NAS de entrada deve ser baseada em uma análise fria do workload. Para tarefas de baixa criticidade, como um repositório secundário ou um alvo de backup para dados não essenciais, ele pode ter seu lugar.

No entanto, para funções centrais como servidor de arquivos principal, armazenamento para virtualização ou alvo primário de backup corporativo, as limitações de desempenho, governança e proteção representam um risco operacional muito elevado.

Uma conversa com especialistas em infraestrutura de armazenamento ajuda a alinhar a tecnologia com a demanda real do negócio. A equipe da Storage House está preparada para essa análise técnica e para desenhar uma solução com a previsibilidade que sua operação exige.

Fale Conosco

Fale Conosco